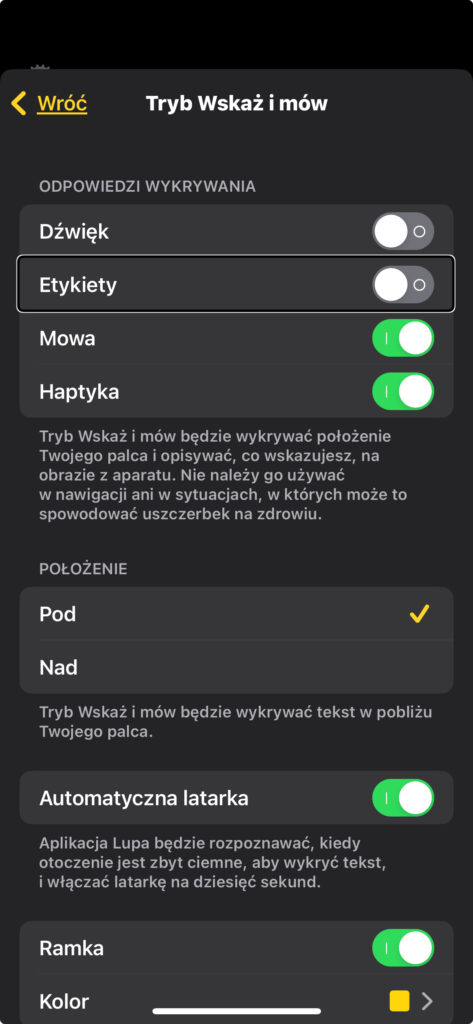

Dla odmiany chciałbym Wam dziś zademonstrować, jak nie działają dwie nowe funkcje dostępnościowe, dodane przez Apple do mobilnych systemów oznaczonych numerem 17, a którymi firma tak się chwaliła w ramach tegorocznego GAAD, czyli Światowego Dnia Świadomości Dostępności (ang. Global Awarenes Accessibility Day). Mowa tutaj o Trybie Wykrywania Tekstu, oraz Trybie Wskaż i Mów. Oba działają tak źle, że gdybyście tylko o tym przeczytali, to na pewno byście nie uwierzyli. 😉 Dlatego musiałem Wam to pokazać. Zapraszam do oglądania.

Obejrzyj film

Aby śledzić kolejne nowości video pojawiające się w Mojej Szufladzie, wystarczy odwiedzić mój kanał w serwisie YouTube i kliknąć przycisk Subskrybuj. Od tej pory, jeśli niczego nie zmienialiście w ustawieniach, będziecie otrzymywać powiadomienia o nowych filmach publikowanych w Mojej Szufladzie.

A jeśli mielibyście jakieś pytania lub propozycje na kolejne filmy tego typu, dajcie proszę znać w komentarzach lub na mojego maila.

Nie zapominajcie również o polubieniu obejrzanego odcinka, zasubskrybowaniu kanału – jeśli jeszcze tego nie zrobiliście, oraz polecaniu go wszystkim osobom poszukującym informacji na temat technologii asystujących dostępnych w środowisku mac lub iOS.

1. Funkcja wykrywania jest w aplikacji Lupa, nie latarka 🙂

2. Teraz jest beta 8, aczkolwiek ja nigdy nie miałem problemów z lagowaniem lupy. To problem warty zgłoszenia. Jakiego modelu iPhone’a dotyczy błąd?

3. Nie trzeba szukać przycisku „wykrywanie tekstu” bo działa standardowy gest wstrzymywania (dwa razy dwa palce).

4. Faktem jest, że mogłaby być jakaś opcja podejrzenia sobie dźwięków tej funkcji, bo tam ich jest parę. Gdyby nie ogień i miecz w postaci rozpakowywania obrazów też bym wielu rzeczy nie wiedział.

5. Nie zgadzam się, że Seeing Assistant działa lepiej. To jest jednak Vision Kit, OCR najlepszy w swojej klasie, aczkolwiek szkoda, że tylko w wersji fast, nie ma możliwości przełączenia się na accurate (tak działa VOCR na Macu).

6. Pozwoliłem sobie nie posłuchać Apple’a i korzystałem z funkcji wykrywania tekstu w nawigacji. Niestety mój brak wyczucia odległości i neonowość warszawskiej galerii handlowej zrobiły swoje, ale coś tam czytało :).

7. U mnie tryb wskaż i mów działa dobrze, jestem praworęczny i robię to tak

7.1. iPhone’a trzymam w lewej ręce w taki sposób, że aparat tylni wskazuje na moją prawą rękę, ergo telefon trzymam ekranem w stronę mojej lewej ręki.

7.2. Palec kładę prostopadle do kadru aparatu, w moim przypadku jest to palec wskazujący

7.3. Musisz oczywiście koordynować ruchy palca z ruchami telefonu, bo kadr w przeciwieństwie do polskiej mowy nie jest gumowy i palec w pewnym momencie z niego wyjdzie.

7.4. Jedyne, z czym jeszcze mam problem to z rozpoznawaniem obiektów takich jak klawiatura, gdzie muszę kierować palec w dół aby na niego wskazać, niemniej jednak z mikrofalą, telefonem bez mowy i pralką działało serio fajnie.

8. Czy masz włączoną funkcję tekst na żywo? Ustawienia > Ogólne > Język i region > Tekst na żywo?

Arku,

Ad. 1. 🙂

Ad. 2. Problem występuje na iPhone 13 Pro. Zaczynam więc podejrzewać, że to może kwestia aparatu. Ty masz model Pro Max? A nagranie powstawało na piątej becie.

Ad. 3. Nie wiedziałem. Dzięki.

Ad. 5. To nie jest kwestia zgody lub jej braku. Ja odnoszę się tylko do praktyki w języku polskim. W angielskim jestem gotów się z tobą zgodzić.

Ad. 6. Ryzykant. 😉

Ad. 7. Ja sprawdzałem różne sposoby i niestety żaden nie sprawdzał się lepiej od pozostałych. Podobnie z przestawianiem w ustawieniach położenia nad lub pod palcem.

Ad. 8. Tak, oczywiście.

Aktualizacja modeli OCR w tym systemie jest niesamowicie dziwna. Polecam wyłączyć live text i włączyć go raz jeszcze po restarcie. On wtedy zaciąga ponownie modele, a przynajmniej tak sądzę po sprawdzeniu sobie zużycia danych przed i po.

U mnie na przykład Seing AI po polsku rozpoznaje niemożebne głupoty i muszę go przełączyć na angielski żeby jakkolwiek nim czytać. Też w sumie ciekawe, ale po tej aplikacji akurat nie płakałem, bo jak już jestem faktycznie przyciśnięty pod murem to daje radę :).

Gdybyś zgłosił błąd odnośnie lagów, podeślij mi proszę FB, wtedy napiszę do jednego gościa z Apple z którym złapałem bezpośredni kontakt, może coś to da.